¡El Festival de Innovación Educativa (FIE) cerró su tercera edición! Durante este evento, creado por docentes y para docentes que se llevó a cabo el pasado 13, 14 y 15 de julio, se logró generar un espacio de intercambio de conocimiento, aprendizaje continuo e innovación en el ámbito de la enseñanza y el aprendizaje. Este festival ha contribuido significativamente al modelo educativo de la UPC, brindando una oportunidad única para explorar el uso de la tecnología en la educación, metodologías innovadoras, evaluaciones, competencias digitales y mucho más.

En esta tercera edición del FIE, hemos sido testigos de una amplia variedad de temas fascinantes. Desde la creciente importancia de la inteligencia artificial en la educación hasta cómo aprovechar esta tecnología para mejorar la experiencia de aprendizaje de los estudiantes, el festival ha abordado las tendencias más relevantes en el campo educativo. Expertos en educación y docentes universitarios destacados se han unido para compartir sus experiencias y conocimientos, enriqueciendo aún más esta comunidad de docentes innovadores.

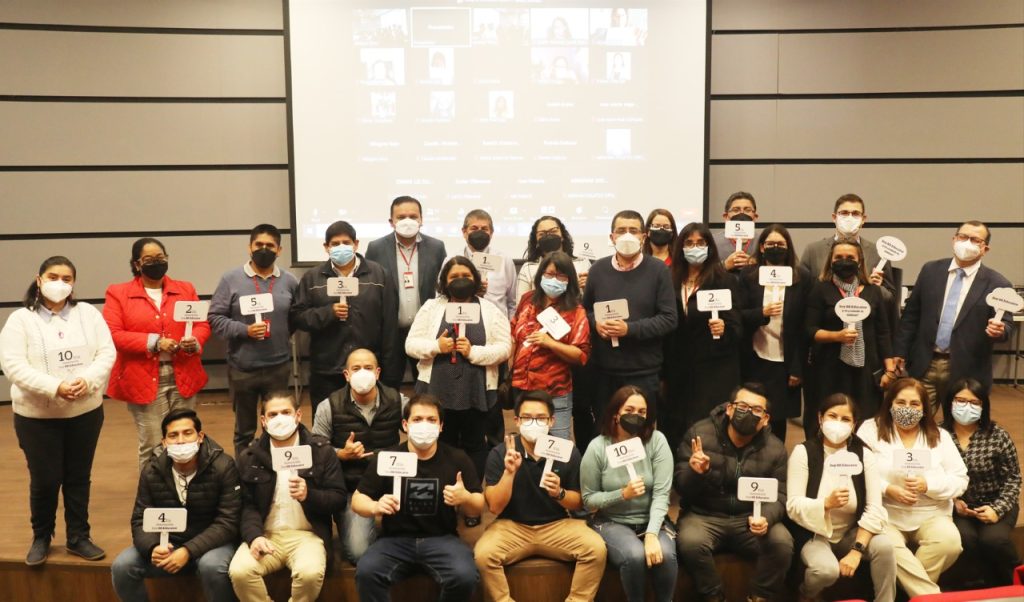

El FIE ha logrado cumplir sus objetivos fundamentales. Por un lado, ha fortalecido la comunidad académica digital al dar visibilidad a las estrategias innovadoras de aprendizaje de los docentes. Además, ha creado comunidades digitales donde los docentes pueden conectar según temas afines, intercambiar experiencias y apoyarse mutuamente en la generación de nuevas estrategias innovadoras. Asimismo se superó las cifras de la edición pasada, tuvimos más docentes interesados en ser expositores y también en los docentes que se sumaron como participantes al Festival.

Durante el festival, los participantes han tenido la oportunidad de disfrutar de una variedad de actividades en línea, como charlas magistrales, webinars y talleres. Cada una de estas actividades ha sido diseñada cuidadosamente para brindar un ambiente propicio para el aprendizaje, la reflexión y la colaboración.

Además, como anunciamos en la bienvenida del FIE, se ha presentado la primera edición de la Revista del Festival de Innovación Educativa, una valiosa compilación que reúne los conocimientos compartidos durante el evento de la edición anterior.

La 3ª edición del FIE ha sido un espacio enriquecedor y estimulante para el intercambio de ideas y la promoción de la innovación en la educación. Agradecemos a todos los participantes, expertos y colaboradores que han contribuido a hacer de este evento un éxito rotundo.

¡Gracias a todos y todas por ser parte de esta increíble experiencia y nos vemos en la próxima edición del FIE 2024!